Além do V3-V4: Estratégias para Mitigar o Viés de Primer e os Efeitos de Lote para Dados Fiáveis de Microbioma

A chamada de base moderna por nanopore já não é um passo leve pós-execução que pode ser atribuído a qualquer estação de trabalho disponível. Na atual pilha de software da ONT, o Dorado é o basecaller padrão integrado no MinKNOW, as famílias de modelos atuais estão explicitamente organizadas em torno de compromissos rápidos, hac e sup, e a documentação do fluxo de trabalho agora trata a chamada de base como parte de uma cadeia de processamento mais ampla, em vez de como um passo de conversão independente. Para as equipas responsáveis pela revisão da qualidade dos dados e compatibilidade do pipeline, isso muda a verdadeira questão de "Podemos executar a chamada de base?" para "Podemos executá-la com um tempo de resposta previsível, saídas compatíveis e uma sobrecarga operacional aceitável?"

Este artigo discute a seleção de infraestrutura, capacidade de processamento, manuseio de dados, embalagem de saída e padrões de revisão operacional para fluxos de trabalho de basecalling de nanopores. Não aborda testes clínicos, uso voltado para o paciente, tomada de decisões diagnósticas, seleção de tratamento ou validação médica regulamentada. Quaisquer referências à qualidade da saída, tempo de resposta ou compatibilidade a jusante dizem respeito estritamente ao desempenho técnico do fluxo de trabalho e à prontidão para entrega de arquivos em ambientes de pesquisa. As equipas devem definir os seus próprios critérios de aceitação interna para o processamento de dados de pesquisa, incluindo proveniência, reprodutibilidade e requisitos de formato de transferência, antes de adotarem execução local, em nuvem ou gerida.

Instantâneo de Decisão Rápida

A execução local de GPU é frequentemente suficiente quando o volume de dados é baixo, a concorrência é limitada e a equipa pode tolerar algum tempo de espera e manutenção do ambiente. A execução elástica ou gerida torna-se mais atraente quando o rendimento mensal é variável, múltiplos projetos competem pelo mesmo hardware, ou as equipas a montante precisam de entrega padronizada de FASTQ ou BAM com uma proveniência clara e mínima transferência manual. Na prática, a decisão raramente se resume a saber se a chamada de base pode ser executada. Trata-se de saber se pode ser executada com um tempo de resposta aceitável, embalagem de saída estável e baixo esforço operacional.

A Demanda de Computação de Alto Desempenho do Basecalling Moderno

De acordo com a documentação atual do Dorado, cada geração de modelo inclui tipicamente variantes fast, hac e sup. Estas são ordenadas por precisão crescente, sendo que modelos maiores são geralmente mais dispendiosos em termos computacionais para avaliar; a ONT também observa que hac é o ponto de equilíbrio recomendado para a maioria dos utilizadores. Este é um sinal operacional importante para o planeamento da infraestrutura: a escolha do modelo não é apenas uma escolha de qualidade, mas também uma escolha de planeamento de capacidade.

Na documentação de basecalling da wf-basecalling da ONT, o basecalling Dorado requer uma GPU NVIDIA com arquitetura Pascal ou mais recente e pelo menos 8 GB de vRAM. A mesma documentação do fluxo de trabalho também deixa claro que o fluxo de trabalho pode aceitar entradas de sinal FAST5 ou POD5 e emitir FASTQ, CRAM ou BAM não alinhado, sendo possível BAM ou CRAM ordenados e indexados quando uma referência é fornecida. Isso significa que as decisões sobre a infraestrutura de basecalling afetam não apenas a velocidade de inferência, mas também a rapidez com que um projeto pode alcançar um estado de transferência pronto para downstream.

O POD5 adiciona outra camada a esta imagem de computação. Na documentação e especificação do POD5 da ONT, o POD5 é descrito como um formato de leitura bruta transmitível armazenado usando estruturas baseadas em Apache Arrow / Feather. Isso é importante porque a velocidade de chamada base não é determinada apenas pela capacidade de processamento da GPU. A GPU precisa ser alimentada de forma eficiente, e gargalos de armazenamento ou de rede podem deixar a computação disponível subutilizada. Para a revisão operacional, isso significa que o layout dos dados brutos, o desempenho local do NVMe, o comportamento do sistema de arquivos compartilhado e a estratégia de preparação podem afetar a taxa de transferência real.

Para um revisor de bioinformática, as questões práticas são, portanto, mais específicas do que "A equipa usou o Dorado?" Um quadro de auditoria mais robusto inclui:

- Qual foi o nível do modelo utilizado e porquê?

- Foi o sinal bruto ingerido do POD5 ou do FAST5 legado?

- O ambiente de execução tinha memória GPU livre suficiente para um dimensionamento de lote estável?

- Os resultados foram entregues no formato esperado pelo fluxo de trabalho subsequente?

- As repetições ou lentidões foram causadas por problemas de enfileiramento, armazenamento ou ambiente em vez de pelo próprio modelo?

Uma configuração que eventualmente produz leituras não é automaticamente adequada para entrega em escala de projeto.

Figura 1. A taxa de basecalling depende do comportamento combinado da velocidade de ingestão do POD5, da capacidade de inferência da GPU, da margem de VRAM disponível e dos passos de geração de saída, como a emissão de BAM ou o encadeamento a montante.

Figura 1. A taxa de basecalling depende do comportamento combinado da velocidade de ingestão do POD5, da capacidade de inferência da GPU, da margem de VRAM disponível e dos passos de geração de saída, como a emissão de BAM ou o encadeamento a montante.

Uma visão prática da seleção de modelos

Para a maioria das equipas, fast, hac e sup devem ser tratados como modos de operação em vez de rótulos:

| Camada do modelo | Caso de uso prático | Força | Principal compromisso |

|---|---|---|---|

| Rápido | Execuções exploratórias rápidas, QC inicial, pré-visualizações de baixa latência | Maior throughput | Tecto de precisão mais baixo |

| HAC | Basecalling de produção geral | Qualidade equilibrada e custo de computação | Ainda precisa de capacidade GPU significativa. |

| SUP | Fluxos de trabalho priorizados pela precisão | Camada de maior precisão | Maior demanda de computação e prazos de entrega mais longos |

Essa estrutura segue a orientação atual do modelo da ONT: modelos maiores custam mais para avaliar, e o hac é geralmente recomendado como o melhor equilíbrio para a maioria dos utilizadores.

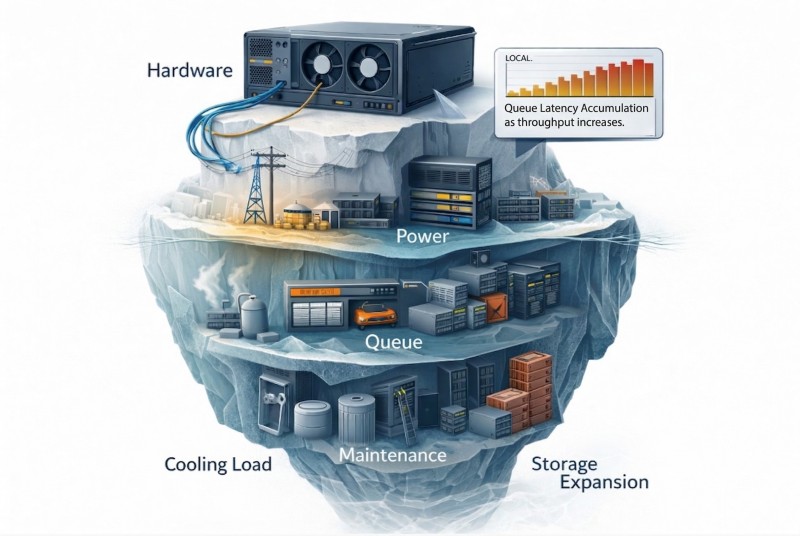

Servidores GPU Locais: A Dívida Técnica Oculta

Um servidor GPU local muitas vezes parece económico porque o custo visível é fácil de quantificar: compra de hardware, um esforço de configuração único e uma sensação de propriedade direta. O fardo menos visível aparece mais tarde. O Dorado continua a evoluir, e a página de lançamentos atual da ONT mostra um histórico de lançamentos ativo com atualizações de funcionalidades e alterações de comportamento em curso. A rápida melhoria de software é valiosa, mas também significa que os ambientes locais requerem manutenção contínua se as equipas quiserem evitar desvios entre tempo de execução, drivers, contentores e expectativas de fluxo de trabalho.

O segundo custo oculto é a latência na fila. Um nó local que funciona bem para processamento ocasional pode tornar-se o gargalo no momento em que múltiplos projetos submetem tarefas ao mesmo tempo. Nessa situação, o tempo de resposta efetivo já não é apenas o tempo de execução. Torna-se tempo de espera, tempo de execução, tempo de repetição e tempo de pós-processamento. Para um responsável de bioinformática, isso é importante porque a revisão a montante não começa quando o cálculo inicia; começa quando os ficheiros são entregues em um estado utilizável.

O terceiro custo oculto é a fragilidade da pilha. Sistemas de fluxo de trabalho como o Nextflow existem para tornar os pipelines computacionais reproduzíveis em ambientes locais, HPC e na nuvem, enquanto o framework nf-core foi criado para suportar pipelines portáteis, curados pela comunidade, com a reprodutibilidade e a padronização em mente. Se um ambiente local não conseguir acompanhar esse modelo de portabilidade, a equipa pode manter a propriedade do hardware, mas perder a estabilidade do fluxo de trabalho.

Concepção errada comum: "Uma estação de trabalho poderosa é suficiente"

Essa suposição só se mantém quando a taxa de transferência é modesta, a concorrência é limitada e os requisitos de tempo de resposta são flexíveis. Torna-se arriscado quando uma equipa está a lidar com múltiplos projetos ativos, utilizando regularmente níveis de modelo de maior custo, ou tentando empacotar resultados para uma entrega padronizada a montante.

Uma pergunta melhor não é se a estação de trabalho consegue completar uma execução, mas sim se consegue fazê-lo repetidamente, sob carga, com consistência suficiente para suportar a revisão do projeto.

Sinais de dívida técnica local em resolução de problemas

| Sintoma | Causa provável | Efeito operacional | Ação corretiva |

|---|---|---|---|

| A utilização da GPU permanece baixa enquanto os trabalhos correm durante muito tempo. | Gargalo de armazenamento ou I/O, má preparação, dimensionamento conservador de lotes | Baixa taxa de transferência apesar do hardware caro | Auditar o caminho de acesso POD5, o desempenho de staging e o armazenamento. |

| O tempo de execução varia drasticamente entre projetos semelhantes. | Fila em um nó partilhado | Inconsistência na entrega | Separe o tempo de espera do tempo de processamento nos relatórios de revisão. |

| As falhas aparecem após as atualizações. | Incompatibilidade entre o driver, CUDA ou o container | Repetições e tempo de inatividade | Ambientes com bloqueio de versão e teste antes da produção |

| Os ficheiros chegam, mas o processamento a jusante para. | A embalagem de saída não corresponde ao ponto de entrada do fluxo de trabalho. | Revisão manual | Defina formatos de transferência e metadados com antecedência. |

Figura 2. O custo operacional da chamada base local com GPU inclui não apenas a aquisição de hardware, mas também arrefecimento, manutenção de software, filas e risco de repetição.

Figura 2. O custo operacional da chamada base local com GPU inclui não apenas a aquisição de hardware, mas também arrefecimento, manutenção de software, filas e risco de repetição.

Nuvem vs. Computação Gerida: Eficiência e Escalabilidade

A principal vantagem da execução em nuvem ou gerida não é apenas o acesso remoto a GPUs. É a capacidade de separar os fluxos de trabalho científicos da propriedade do hardware.

O Nextflow suporta a execução em sistemas locais, agendadores HPC e back-ends orientados para a nuvem, e o framework nf-core formaliza o empacotamento reprodutível de pipelines para fluxos de trabalho de bioinformática. Em termos práticos, isso significa que a chamada de bases Nanopore pode agora ser tratada como uma carga de trabalho portátil em vez de uma tarefa vinculada a uma máquina. Uma vez que um fluxo de trabalho é portátil, a questão limitante passa de "Qual estação de trabalho temos?" para "Qual modelo de execução oferece o melhor tempo de resposta, reprodutibilidade e padrão de entrega?"

A execução gerida também ajuda quando o rendimento se torna desigual. Um servidor local é geralmente projetado em torno de um caso médio, mas projetos de sequenciação reais costumam surgir em picos. A execução elástica permite que as equipas lidem com a demanda máxima sem dimensionar o hardware local em torno de picos raros. Também cria um caminho melhor para encadear a chamada de base em fluxos de trabalho de leitura longa padronizados, como Sequenciação de alvo por nanoporo ou Sequenciação ultra-longa por nanopore, onde a computação, a embalagem de ficheiros e as expectativas a montante precisam de estar alinhadas desde o início.

Uma camada de computação gerida torna-se especialmente atraente quando a necessidade real não é "tempo de GPU" de forma abstrata, mas sim o empacotamento de saída consciente do fluxo de trabalho. Na documentação atual do fluxo de trabalho da ONT, a chamada de base pode alimentar diretamente saídas alinhadas ou não alinhadas, dependendo da configuração. Isso está muito mais próximo de como os revisores técnicos realmente experienciam a qualidade da entrega: não como uma pontuação de referência, mas como uma questão de saber se os arquivos recebidos estão prontos para o próximo passo sem limpeza manual.

Matriz de Decisão Estratégica: Quando Externalizar o Seu Computador?

Uma decisão prática de externalização deve ser baseada na forma da carga de trabalho, concorrência, capacidade interna de engenharia e na rigidez do padrão de entrega.

| Situação | GPU local geralmente suficiente | A execução gerida ou elástica é geralmente mais forte. |

|---|---|---|

| Baixo e estável volume mensal de produção | Sim | Geralmente desnecessário |

| Vazão mensal variável | Às vezes | Muitas vezes sim |

| Múltiplos grupos a partilhar um nó | Arriscado | Normalmente sim |

| A equipa pode manter a pilha de execução com confiança. | Possivelmente | Depende do custo de oportunidade. |

| A transferência padronizada a jusante é crítica. | Frequentemente difícil | Normalmente sim |

| Modelos de maior custo utilizados rotineiramente | Frequentemente limitado | Normalmente sim |

A variável oculta é o tempo das pessoas. Quando a equipa experiente de bioinformática gasta esforço a resolver problemas de execução em vez de rever resultados, otimizar análises ou padronizar entregas, a equipa está a pagar um imposto de infraestrutura que raramente aparece nas folhas de cálculo de aquisição.

Elabore perguntas de auditoria a serem feitas antes do início de um projeto.

- Qual é a expectativa em relação à variabilidade da entrada mensal de dados brutos?

- Qual é o tempo de espera aceitável antes de começar a chamada base?

- Quais artefatos de saída são necessários: FASTQ, BAM não alinhado, BAM alinhado, CRAM ou múltiplas formas?

- Qual modelo de nível Dorado será utilizado para a entrega de produção?

- Os passos do fluxo de trabalho a jusante começarão automaticamente ou através de transferência manual?

- Quem é responsável pela manutenção do ambiente e pelas reinicializações quando as dependências de software mudam?

Quando as respostas são incertas, o problema geralmente é maior do que a seleção de hardware. É uma questão de governança do fluxo de trabalho.

Para a transferência específica de fluxo de trabalho, o suporte relacionado ao empacotamento de long-read pode ser mais importante do que o acesso genérico a computação. É por isso que algumas equipas procuram escopos de serviço que já se alinhem com as expectativas de saída ao nível do ensaio, como Sequenciação de Transcritos de Comprimento Completo (Iso-Seq) ou Análise de Amplicão Longo (AAL), em vez de tratar a chamada de base como um passo técnico isolado.

Normas Técnicas de Entrega para Transferência de FASTQ/BAM

A aceitação para a basecalling externalizada deve ser definida como um padrão de entrega técnica que abrange compatibilidade de formato, proveniência e auditabilidade.

Um pacote de entrega robusto deve especificar claramente:

- tipo de entrada bruta recebido

- chamador de base e versão

- nível de modelo utilizado

- se a chamada de base modificada estava ativada

- tipos de ficheiros de saída entregues

- métricas de resumo e notas de execução

- somas de integridade

- quaisquer repetições, exclusões ou exceções de embalagem

Esse padrão é mais útil do que uma discussão vaga sobre "qualidade", porque define o que a equipa receptora pode realmente verificar.

A compatibilidade de formatos de ficheiro é mais importante do que a completude genérica.

FASTQ continua a ser a transferência genérica mais segura para muitos fluxos de trabalho personalizados a jusante. BAM não alinhado pode ser valioso quando é preferida uma embalagem rica em metadados. BAM ou CRAM alinhados são úteis quando o âmbito do serviço inclui explicitamente o alinhamento contra uma referência definida e a equipa receptora espera saídas mapeadas.

Onde o fluxo de trabalho mais amplo se estende à caracterização de sequências a jusante, o padrão de embalagem mais útil é geralmente definido pelo ponto de entrada da análise, metadados esperados e formato de transferência, em vez de apenas pelo cálculo. É por isso que algumas equipas alinham a entrega de basecalling com os fluxos de trabalho que já utilizam para Sequenciação de Região Alvo ou Serviços de Sequenciação de Amplicõesonde a estrutura de ficheiros e as expectativas de metadados já estão bem definidas.

Uma lista de verificação compacta para auditoria de fornecedores

Antes de aceitar um modelo de entrega, pergunte se o fornecedor pode documentar:

| Pergunta de auditoria | Por que é importante |

|---|---|

| A versão do chamador de base está registada? | Suporta a reprodutibilidade e a resolução de problemas. |

| Está o nível do modelo documentado? | Explica os compromissos entre throughput e qualidade. |

| Os formatos de saída estão predefinidos? | Reduz a fricção a montante. |

| Estão incluídos os registos e os ficheiros de resumo? | Melhora a auditabilidade |

| São fornecidos checksums? | Confirma a integridade da transferência |

| As repetições estão documentadas? | Ajuda a explicar a variância inesperada. |

QC e Resolução de Problemas: O que Auditar Quando o Rendimento ou Saída Parecer Errado

O rendimento é inferior ao esperado.

Primeiro, verifique se o gargalo é realmente computacional. De acordo com a documentação atual do POD5, o formato é transmissível e projetado para um manuseio acessível de leitura bruta, mas isso não elimina os gargalos de armazenamento. Discos locais lentos, congestionamento de rede compartilhada ou um estágio fraco podem reduzir a taxa de transferência efetiva, mesmo quando a capacidade da GPU está disponível.

O tempo de resposta é inconsistente entre projetos semelhantes.

Isto é frequentemente um problema de agendamento em vez de um problema de basecalling. Separe o tempo de fila do tempo de execução nos relatórios. Sem essa distinção, as equipas não conseguem perceber se a questão é o custo do modelo, a capacidade da infraestrutura ou a contenção de carga de trabalho.

As leituras entregues parecem diferentes de um lote anterior.

Revise se o mesmo nível de modelo, versão de runtime e modo de saída foram utilizados. A documentação atual do Dorado distingue explicitamente os modelos rápido, hac e sup pela precisão e custo computacional, portanto, as variações de saída podem refletir escolhas operacionais em vez de instabilidade aleatória.

Os ficheiros BAM são mais difíceis de usar do que o esperado.

Confirme se os ficheiros estão alinhados ou desalinhados e se a embalagem corresponde ao ponto de entrada do fluxo de trabalho a montante. Na documentação de wf-basecalling da ONT, o fluxo de trabalho pode produzir FASTQ, CRAM ou BAM desalinhado, com saídas mapeadas ordenadas e indexadas quando o alinhamento guiado por referência está incluído. Essas distinções devem ser definidas antes da entrega, não inferidas posteriormente.

Sinais de Outsourcing: Quando Manter Internamente Deixa de Ser Eficiente

A execução gerida torna-se mais atractiva quando o empacotamento de computação, o tempo de resposta e a transferência para a fase seguinte precisam de ser padronizados em conjunto, em vez de serem otimizados separadamente.

Isso geralmente acontece quando várias pressões aparecem ao mesmo tempo: chegada de dados brutos em picos, competição por hardware partilhado, manutenção repetida do ambiente e aumento da demanda por padrões consistentes de entrega de arquivos. Nesse contexto, a unidade económica já não é a GPU em si. É todo o fluxo de trabalho, desde a ingestão do sinal até à saída empacotada.

Para algumas equipas, esta mudança é mais fácil de gerir quando o contexto de computação e ensaio está agrupado em categorias de serviço, como Sequenciação do Genoma Viral ou Sequenciação do Genoma Completo Microbianoonde o processamento de leituras longas, as expectativas de entrega e a revisão de sequências subsequentes podem ser padronizados em conjunto.

Conclusão: Acelerar a Pesquisa ao Desacoplar a Ciência da Infraestrutura

Em ambientes RUO, um acesso mais rápido a saídas FASTQ ou BAM confiáveis significa uma revisão posterior mais cedo, uma resolução de problemas mais rápida e decisões de projeto mais precoces. O stack atual da ONT já reflete esta mudança: o Dorado é o basecaller padrão integrado com o MinKNOW, as famílias de modelos atuais estão documentadas abertamente em relação aos trade-offs entre computação e precisão, e a documentação oficial do fluxo de trabalho considera o basecalling como uma parte configurável de uma cadeia de saída maior. Equipas que ainda avaliam o basecalling como uma tarefa simples de estação de trabalho provavelmente estão a subestimar tanto os requisitos de computação quanto os requisitos de entrega.

A decisão mais útil não é, portanto, "local versus nuvem" de forma abstrata. É saber se a infraestrutura atual consegue converter sinais brutos em saídas padronizadas e compatíveis com os processos subsequentes, com um tempo de resposta aceitável e sem consumir um esforço científico desproporcional. Quando a resposta é não, a execução gerida ou externalizada não é apenas uma conveniência. É um passo de otimização do fluxo de trabalho.

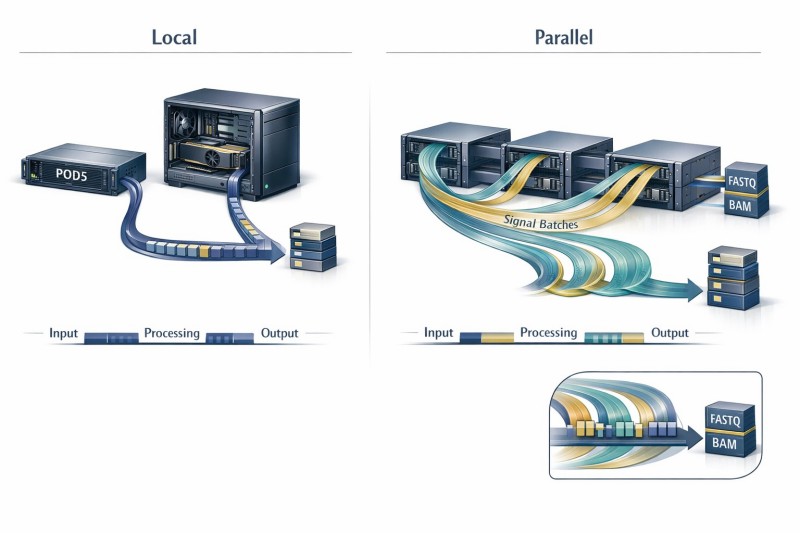

Figura 3. O processamento paralelo gerido ou baseado em plataforma pode reduzir o backlog e melhorar a consistência na entrega ao converter as entradas do POD5 em saídas FASTQ/BAM padronizadas sob regras de fluxo de trabalho partilhadas.

Figura 3. O processamento paralelo gerido ou baseado em plataforma pode reduzir o backlog e melhorar a consistência na entrega ao converter as entradas do POD5 em saídas FASTQ/BAM padronizadas sob regras de fluxo de trabalho partilhadas.

Perguntas Frequentes

1. A aceleração por GPU é opcional para a chamada de bases moderna do Nanopore?

Não na maioria dos ambientes sensíveis ao desempenho. A documentação atual do fluxo de trabalho da ONT requer uma GPU NVIDIA com arquitetura Pascal ou mais recente e pelo menos 8 GB de vRAM para a chamada de base wf-basecalling baseada em Dorado.

2. Qual é o nível de modelo mais prático por defeito?

Para muitos fluxos de trabalho de produção, o hac é o equilíbrio mais prático porque a ONT o recomenda como a melhor compensação entre precisão e custo computacional para a maioria dos utilizadores.

3. Por que é que o POD5 é importante para o planeamento de infraestruturas?

Porque o POD5 é transmissível e baseado em estruturas Apache Arrow, o que torna o acesso a dados brutos e a preparação parte da equação de rendimento, em vez de ser uma reflexão tardia.

4. Quando é que um servidor GPU local ainda é suficiente?

Normalmente, quando o volume de dados é baixo, a concorrência é limitada e a equipa pode tolerar algum enfileiramento e manutenção do ambiente.

5. O que deve incluir cada entrega externalizada?

No mínimo: formato de entrada, versão do chamador de base, nível do modelo, tipo de saída, métricas resumidas e somas de verificação de integridade.

Devo solicitar FASTQ ou BAM?

Solicite o formato que corresponda ao ponto de entrada do seu fluxo de trabalho a montante. FASTQ é a entrega genérica mais segura; BAM é útil quando o manuseio de metadados ou saídas mapeadas já fazem parte do plano do fluxo de trabalho.

7. A execução gerida supera sempre a infraestrutura local?

Não. Cargas de trabalho estáveis e de baixo volume ainda podem adequar-se bem à infraestrutura local. A execução gerida torna-se mais atrativa quando a carga de pico, o enfileiramento e a padronização são mais importantes.

8. Qual é o sinal mais claro de que a externalização é justificada?

Quando a equipa passa mais tempo a manter o ambiente de execução do que a rever ou a utilizar os dados.

Referências avaliadas por pares

- Di Tommaso P, Chatzou M, Floden EW, Prieto Barja P, Palumbo E, Notredame C. Análise abrangente de referência e arquitetónica de modelos de deep learning para a chamada de bases de sequenciação por nanopore. Nature Biotechnology. 2017;35(4):316-319. 10.1038/nbt.3820

- Wick RR, Judd LM, Holt KE. Desempenho de ferramentas de basecalling com rede neural para sequenciação Oxford Nanopore. Genome Biology. 2019;20:129. 10.1186/s13059-019-1727-y

- Pagès-Gallego M, de Ridder J. Análise abrangente de referência e arquitetónica de modelos de aprendizagem profunda para a chamada de bases de sequenciação por nanopore. Genome Biology. 2023;24:71. 10.1186/s13059-023-02903-2

- Ewels PA, Peltzer A, Fillinger S, Patel H, Alneberg J, Wilm A, Garcia MU, Di Tommaso P, Nahnsen S. A estrutura nf-core para pipelines de bioinformática curados pela comunidade. Nature Biotechnology. 2020;38:276-278. 10.1038/s41587-020-0439-x

- Abel NB, de Lannoy C, Loose M, Leggett RM. Pod5Viewer: uma interface gráfica para inspecionar dados brutos de sequenciação por nanoporo. Bioinformática. 2024. 10.1093/bioinformatics/btae665

Serviços Relacionados

Diretrizes para Submissão de Amostras

Diretrizes para Submissão de Amostras